GPT-5.4 mini & nano: Thiết Kế Coding Subagents Nhanh Hơn, Rẻ Hơn Mà Không Mất Chất Lượng

OpenAI vừa ra mắt GPT-5.4 mini và nano — hai model nhỏ được tối ưu cho coding workflows và subagents. Đây là cách thiết kế lại pipeline của bạn theo mô hình planner-worker để cắt giảm latency và chi phí.

TL;DR

OpenAI ra mắt GPT-5.4 mini và nano ngày 17/3/2026 — hai model nhỏ nhanh gấp 2x so với GPT-5 mini, được tối ưu đặc biệt cho coding workflows và subagents. Mô hình planner-worker: GPT-5.4 lập kế hoạch, mini/nano thực thi song song — là pattern giúp giảm latency và chi phí đáng kể mà không đánh đổi chất lượng.

Một trong những bài toán thực tế nhất khi xây dựng AI coding tools: bạn không cần model lớn nhất cho mọi bước.

Codebase search? Targeted diff? Unit test fix? Đây là những task lặp lại, có scope rõ, không cần full reasoning power của một model flagship.

Đó chính là lý do OpenAI ra mắt GPT-5.4 mini và nano.

Những Gì Thực Sự Mới

Theo OpenAI announcement (17/3/2026):

"GPT-5.4 mini significantly improves over GPT-5 mini across coding, reasoning, multimodal understanding, and tool use, while running more than 2x faster. It also approaches the performance of the larger GPT-5.4 model on several evaluations, including SWE-Bench Pro."

GPT-5.4 mini:

- Chạy nhanh hơn 2x so với GPT-5 mini

- Tiệm cận performance GPT-5.4 lớn trên SWE-Bench Pro và OSWorld-Verified

- Phù hợp: targeted edits, codebase navigation, front-end generation, debugging loops

- Reasoning effort cao nhất:

high

GPT-5.4 nano:

- Model nhỏ và rẻ nhất của GPT-5.4

- OpenAI khuyến nghị cho: classification, data extraction, ranking, và coding subagents xử lý supporting tasks đơn giản

- Không phải thay thế mini — là tier riêng cho tasks cụ thể

Planner-worker pattern: GPT-5.4 lập kế hoạch, mini/nano subagents thực thi song song

Pricing Thực Tế

| Model | Input | Output | Context |

|---|---|---|---|

| GPT-5.4 mini | $0.75 / 1M tokens | $4.50 / 1M tokens | 400k |

| GPT-5.4 nano | $0.20 / 1M tokens | $1.25 / 1M tokens | — |

| GPT-5.4 (lớn) | $5 / 1M tokens | $25 / 1M tokens | — |

Trong Codex: GPT-5.4 mini chỉ dùng 30% quota của GPT-5.4 — hiệu quả hơn ~3x về chi phí cho simpler coding tasks.

Mini vs Nano: Khi Nào Dùng Cái Nào?

| Task | Mini | Nano |

|---|---|---|

| Targeted file edits | ✅ Tốt nhất | ❌ Có thể miss context |

| Codebase search và summarize | ✅ | ⚠️ Chỉ với files nhỏ |

| Debugging loops | ✅ | ❌ |

| Front-end code generation | ✅ | ❌ |

| Classification / labeling | ⚠️ Overkill | ✅ Tốt nhất |

| Data extraction / ranking | ⚠️ | ✅ |

| Simple code edits (1-5 lines) | ⚠️ | ✅ |

| Unit test fix phức tạp | ✅ | ❌ |

| Screenshot interpretation | ✅ | ❌ |

Rule of thumb: Dùng nano khi task có input/output rõ ràng, bounded scope. Dùng mini khi task cần reasoning nhẹ hoặc code generation.

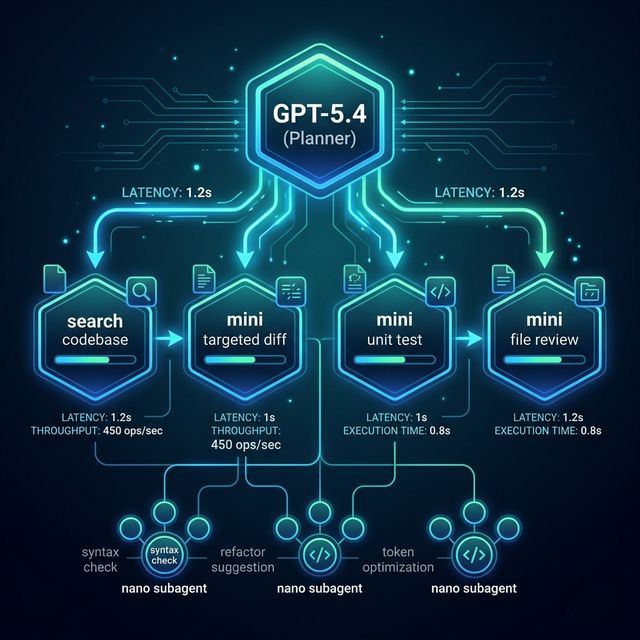

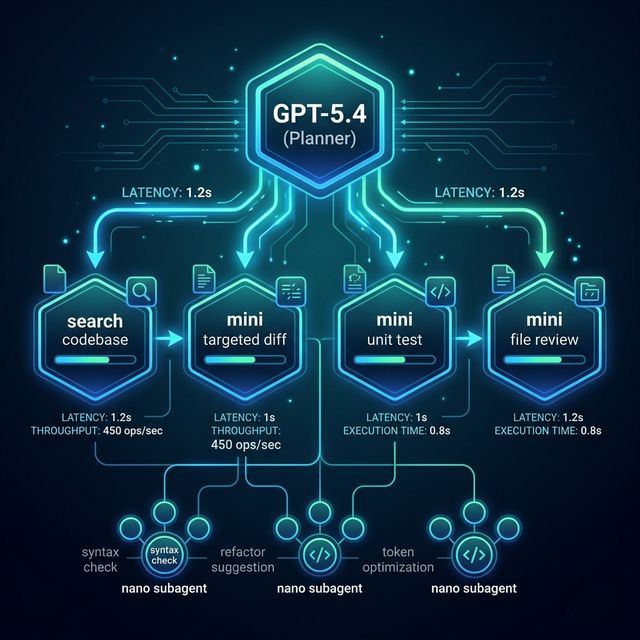

Planner-Worker Architecture

Đây là pattern OpenAI chỉ rõ trong announcement — và nó thay đổi cách bạn thiết kế agent pipelines:

GPT-5.4 (Planner)

│

├── Phân tích yêu cầu

├── Chia task thành subtasks

├── Phán đoán độ phức tạp mỗi task

└── Điều phối mini/nano subagents

│

├── mini: search codebase

├── mini: review large file

├── mini: generate targeted diff

└── nano: classify error type

"In Codex, a larger model like GPT-5.4 can handle planning, coordination, and final judgment, while delegating to GPT-5.4 mini subagents that handle narrower subtasks in parallel." — OpenAI

Workflow Recipe Thực Tế

Bước 1: Planner phân tích và tạo task graph

Dùng GPT-5.4 đầy đủ cho planning — đây là phần cần reasoning cao nhất.

Bước 2: Phân loại subtask và chọn model

def select_model(task_type: str) -> str:

nano_tasks = ["classify", "extract", "rank", "simple_edit"]

mini_tasks = ["search", "diff", "debug", "generate", "review_file"]

if task_type in nano_tasks:

return "gpt-5.4-nano"

elif task_type in mini_tasks:

return "gpt-5.4-mini"

return "gpt-5.4"

Bước 3: Chạy subtasks song song

import asyncio

async def run_subtasks(task_graph):

tasks = [

execute_with_model(subtask, select_model(subtask.type))

for subtask in task_graph.subtasks

]

return await asyncio.gather(*tasks)

Bước 4: Planner aggregate và final judgment

GPT-5.4 lớn review tất cả kết quả từ subagents và tạo output cuối.

Bước 5: Retry với fallback

async def execute_with_retry(subtask, model, fallback="gpt-5.4"):

try:

return await execute_with_model(subtask, model)

except QualityCheckFailed:

return await execute_with_model(subtask, fallback)

Checklist Cost/Performance

Trước khi migrate pipeline sang mini/nano:

- Chọn model nhỏ nhất pass quality bar — test từng loại task riêng

- Đo latency từng step, không chỉ tổng thể — bottleneck thường ở tool calls

- Shadow evaluation — chạy mini song song với GPT-5.4 trên 5-10% traffic trước khi migrate

- Track tool-call overhead riêng — latency thực = model time + code execution time

- Set quality thresholds rõ ràng trước khi bật auto-fallback

Pitfalls Thường Gặp

Over-delegation vào nano: Nano mạnh cho classification nhưng yếu với multi-step reasoning. Đừng giao debugging phức tạp.

Poor prompt boundaries: Mini/nano cần prompts tập trung. Context thừa ảnh hưởng chất lượng nhiều hơn với model nhỏ.

Bỏ qua tool-call overhead: Một subagent chạy code execution có thể tốn thời gian hơn model latency. Đo cả hai.

Migrate toàn bộ cùng lúc: Bắt đầu với một pipeline cụ thể, đo kết quả, rồi mở rộng dần.

Availability

- GPT-5.4 mini: API (400k context), Codex (app/CLI/IDE/web), ChatGPT (Free và Go qua "Thinking" feature)

- GPT-5.4 nano: API only (

$0.20/$1.25per 1M tokens)

FAQ

GPT-5.4 mini có thay thế được GPT-5 mini không? Theo OpenAI: có — mini consistently outperforms GPT-5-mini ở similar latencies. Nên migrate.

Nano có dùng tool calling không? Có, nhưng reliability thấp hơn mini với complex tool chains. Phù hợp single-tool calls đơn giản.

Codex có tự động dùng mini subagents không? Có — trong Codex, bạn có thể configure để delegate sang mini subagents. Mini dùng 30% quota của GPT-5.4.